近日,上海理工大学健康学院郭旭东教授团队在人工智能医学影像领域顶级期刊《医学影像分析》(Medical Image Analysis)上发表了题为《UTMorph:一种用于活检穿刺中弱监督多模态图像配准的混合CNN-Transformer网络》的创新研究成果。该期刊影响因子为11.8,是JCR Q1区的中科院一区顶刊。健康学院郭旭东教授与硕士生陈沛羽为论文共同第一作者,上海理工大学为第一单位。

前列腺癌是全球男性最常见的恶性肿瘤之一,穿刺活检是确诊的“金标准”。目前,将术前磁共振(MRI)与术中超声(TRUS)融合导航是临床主流方案。然而,现有的临床工作流常面临技术瓶颈:传统的刚性配准无法补偿软组织形变;而主流的非刚性配准方法往往计算耗时且难以精准捕捉局部的复杂形变。这些局限性导致术中肿瘤边界模糊、定位偏差,增加了临床漏诊的风险。

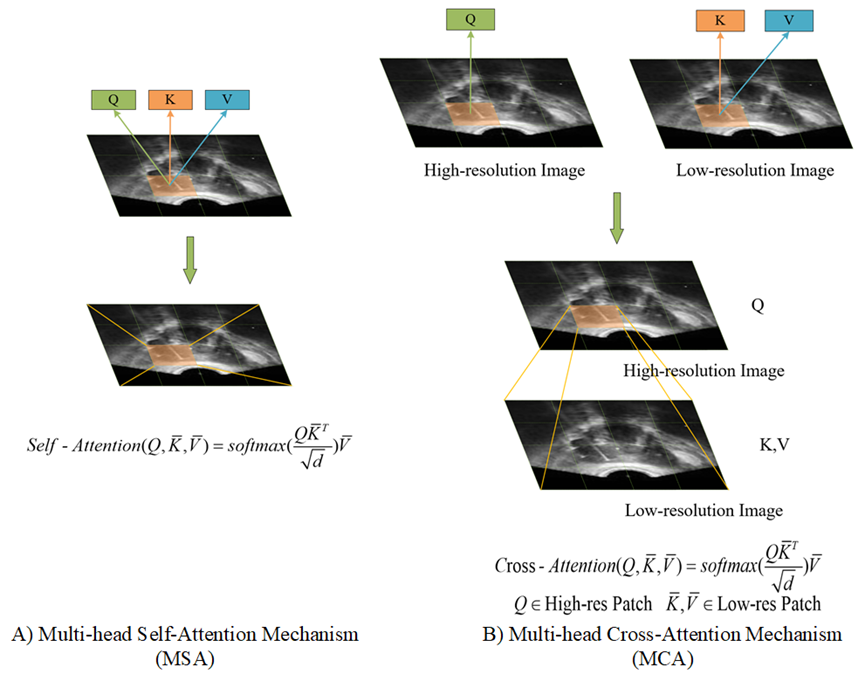

针对这一临床痛点,研究团队联合上海市东方医院,提出了一种名为“UTMorph”的创新深度学习框架。该模型巧妙结合了卷积神经网络(CNN)提取局部特征的能力与Transformer捕捉全局依赖的优势,专为解决多模态图像的复杂形变而设计。团队引入了新型注意力机制及“混合边缘损失函数”,在保证形变估计精度的同时,显著提升了模型对肿瘤边界的感知能力。

实验结果显示,该模型在包含704例患者的临床数据集中表现优异:戴斯相似系数(DSC)达0.890,第95百分位豪斯多夫距离(HD95)缩小至2.679毫米,且平均推理速度仅需24毫秒,完全满足术中实时导航的需求。

该成果不仅突破了现有方法在边界对齐上的技术瓶颈,更为下一代实时、精准的机器人辅助及影像引导的人工前列腺穿刺提供了强有力的算法支撑。团队积极响应国家关于高端医疗装备自主可控的战略号召,坚持“临床需求驱动技术创新”,致力于推动医学影像AI成果在手术导航系统中的转化应用,切实服务人民健康。

注意力机制原理图